展望2018 AI芯片領域:眾多廠商追隨深度學習

高通公司下一代核心研發總監Karam Chatha表示:“軟件總是在變化的,但是你需要盡早把硬件拿出來,因為它會影響軟件——這種關系總是存在的。目前,這家移動芯片廠商正在Snapdragon片上系統的DSP和GPU內核上運行神經網絡工作,但一些觀察家預計,高通將為機器學習定制一個新的模塊,作為2019年的7納米Snapdragon SoC的一個組成部分。

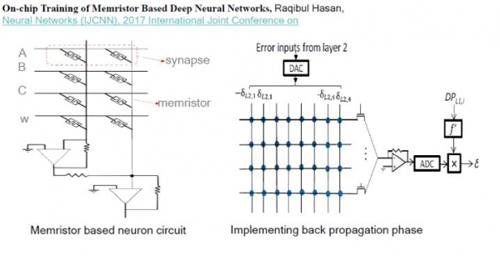

高通公司展示了一個自定義深度神經網絡加速器的研究范例,但是現在高通在通用的DSP和GPU核心上使用軟件。來源:高通

Patterson表示:“市場會決定哪些芯片最好。這是很殘酷的,但這正是設計計算的興奮點所在。”

早期的玩家已經抓住了這個偶然的機會

例如,Facebook最近證明,通過大幅增加打包到所謂批量大小的功能數量,將訓練時間從一天縮短到一個小時。對于試圖在本地SRAM中運行所有操作的Graphcore來說,這可能是個壞消息,因為這消除了外部DRAM訪問的延遲,同時也限制了內存占用。

“他們是為小批量設計的,但幾個月前的軟件結果表明,你需要一個大批量。這說明了事情變的話的有多么快,”Patterson說。

另一方面,Rex Computing認為他們正處于一個有利的位置。該初創公司的SoC最初是為高性能服務器設計的,使用了一種新穎的暫存器內存。聯合創始人Thomas Sohmers說,Rex的方法消除了在虛擬頁面表中緩存數據的需求,這是GPU使用的一種技術,增加了延遲。

因此他說,Rex芯片比現在的GPU要好得多,特別是在處理流行的矩陣/矢量運算神經網絡時。Rex公司計劃6月份推出256核的SoC,預計能提供256Gflops/W。

與此同時,研究人員正在嘗試從32位到單浮點和整數數學的方方面面,以找到最有效的方法來計算神經網絡結果。有一點似乎是他們認同的,最好不要在精確度之間來回切換。

人工智能算法還處于初期階段

深度神經網絡是幾十年來人工智能領域一直進行的相對較小分支的工作。從2012年左右開始,包括Facebook公司的Yann LeCun在內的很多研究人員開始使用特定種類的深度神經網絡來識別圖像,并最終以比人類更高的準確度得到令人驚嘆的結果。深度學習技術吸引了研究界,研究界迅速發表了不少該領域的論文,以尋求新的突破。

現在深度神經網絡為Amazon Alexa、谷歌翻譯、Facebook面部識別等商用服務提供動力。網絡巨頭們和他們的全球競爭對手,正在尋找殺手級應用的過程中競相將這些技術應用于盡可能多的服務中。

-

區塊鏈跨域安全解決方案

-

2018年的五個網絡安全預測

2018-01-25網絡安全 -

中國公有云幸存者特質分析